# テキストのモデレーション

このアクションを使用して、入力テキストがOpenAIのコンテンツポリシーに違反しているかどうかをチェックします。詳細については、こちら (opens new window)をご覧ください。 このアクションでは、特定の基準に基づいてテキストコンテンツをフィルタリング、モデレート、および分類することができます。このAPIは、以下のようなさまざまなユースケースで使用することができます。

- コンテンツのモデレーション: 企業は、ソーシャルメディアプラットフォームやフォーラムなどのユーザー生成コンテンツから不適切または攻撃的なコンテンツを自動的にフィルタリングするために、このアクションを使用することができます。

- カスタマーサービス: このアクションを使用して、顧客の問い合わせやクレームをメッセージの内容に基づいて適切な部署やエージェントに自動的に分類およびルーティングすることができます。

- 感情のモニタリング: ユーザーは、テキストのモデレーションアクションを使用して、ソーシャルメディアや他のオンラインプラットフォームで自社ブランドの言及を監視し、感情に基づいて自動的に分類することができます。これにより、ネガティブなコメントや顧客のクレームに迅速に対応することができます。

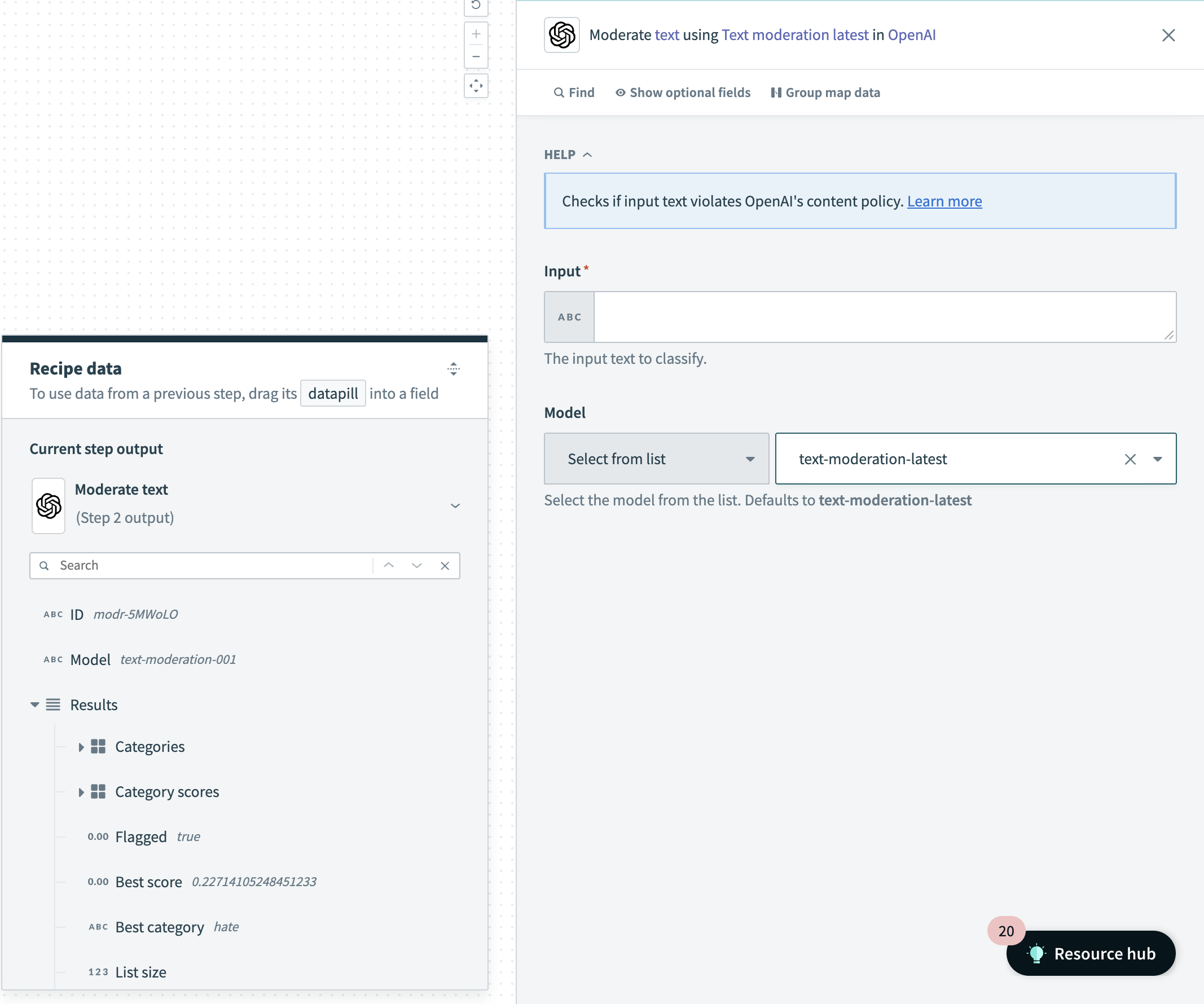

テキストのモデレーションアクション

テキストのモデレーションアクション

# 入力

| フィールド | 説明 |

|---|---|

| Input | 分類する入力テキスト。関連するテキストのリストを入力することもできます。 |

| Model | テキストをモデレーションするために使用するOpenAIモデルを選択します。デフォルトではtext-moderation-latestが選択され、OpenAIが自動的にアップグレードします。text-moderation-stableを使用する場合、OpenAIはモデルを更新する前に事前通知を提供します。text-moderation-stableの精度は、text-moderation-latestよりもわずかに低い場合があります。 |

# 出力

Last updated: 2024/2/13 16:59:53